大家好久不见,小颜最近上网看见这个AI的事闹的沸沸扬扬,也有人问我,对于AI的看法,就我个人而言,我认为AI绝对是对于学习与研究有力的工具,合理的运用AI,能让你的效率翻倍,毕竟拥抱AI才是当下的潮流,这不是选择题而是必修课。

所以今天小颜给大家带来一篇讲述AI底层逻辑框架的文章,大家看完之后,应该会对AI的工作机制有一定了解。

AI底层逻辑框架探索

01 核心引擎与数据单元(LLM & Token)

LLM( Large Language Model ,大语言模型 ):基于海量文本数据训练、具备千亿级参数规模的生成式预训练语言模型,是 AI 对话、文案创作、逻辑推理、代码生成等能力的底层核心引擎。

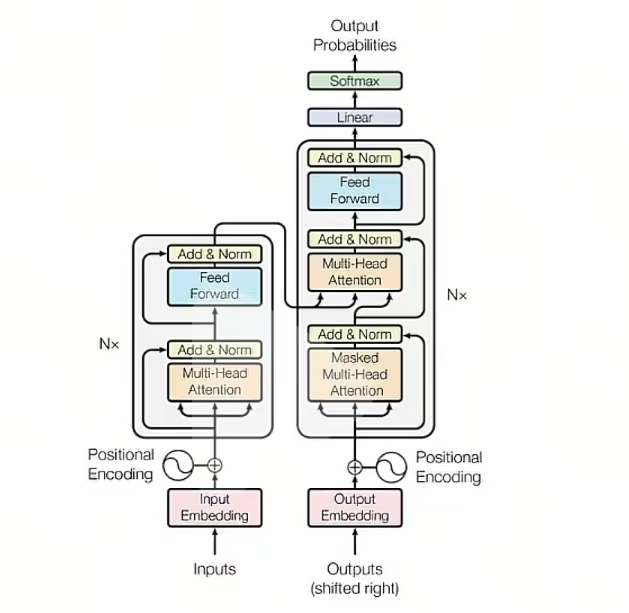

你可以把它理解为大模型的心脏,它的底层架构早在2017年就由Google提出,给它命名Transformer 架构。

上面这个复杂的流程图就是Transformer 架构,我们不用去完全的理解它的意思,我们只需要知道,现在市面上几乎所有的大模型如:豆包,千问,ChatGPT,Grox........等等,我举例的只是比较知名的,他们底层核心基石,都是上面这个架构图。